此章节将记录回归分析课程中的知识点,供复习使用。

一元线性理论回归模型

y=β0+β1x+εE(ε∣X)=0var(ε∣X)=σ2 另一种表示方法

E(y∣x)=βo+β1xvar(y∣x)=σ2 待估参数为:截距项β0,斜率β1,方差σ2

误差随机项

εiGauss-Markov条件

高斯马尔科夫条件是最小二乘(OLS)的前提

E(εi)=0Var(εi)=σ2Cov(εi,εj)=0,i=j 经验回归方程通过数据的重心(xˉ,yˉ)

β^0=yˉ−β^1xˉβ^1=Lxy/Lxx其中Lxx=i=1∑n(xi−xˉ)2=i=1∑nxi2−n(xˉ)2Lxy=i=1∑n(xi−xˉ)(yi−yˉ)=i=1∑nxiyi−nxˉyˉ β1与相关系数的关系

<\div>

<\div>

仅考虑β0,β1估计时,与最小二乘原理相同。进一步对σ2的估计为

σ2=n1i=1∑n(yi−y^i)2=n1i=1∑nei2 但是这是一个有偏估计量,所以一般采用调整后的无偏估计量作为方差的估计具体将在残差性质中证明

E(∑ei2)=(n−2)σ2σ^2=n−21i=1∑n(yi−yˉ)2 线性性

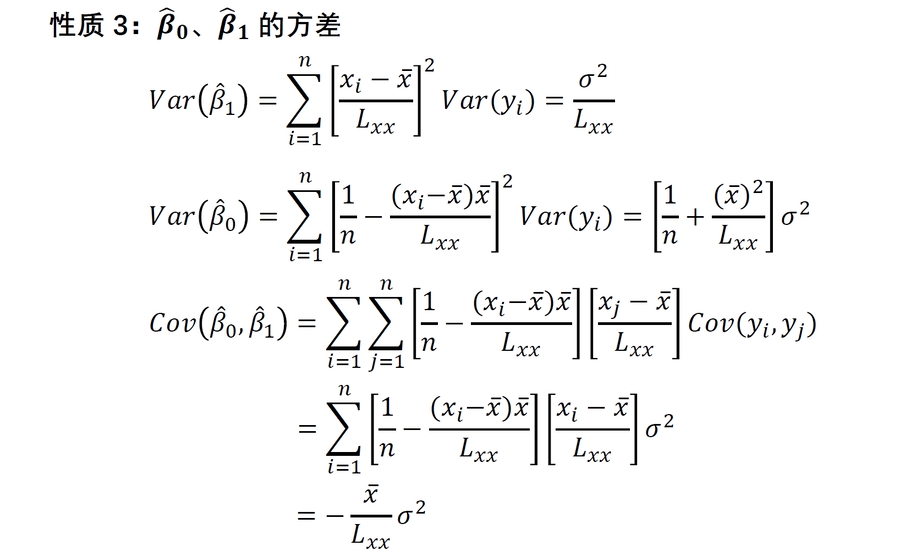

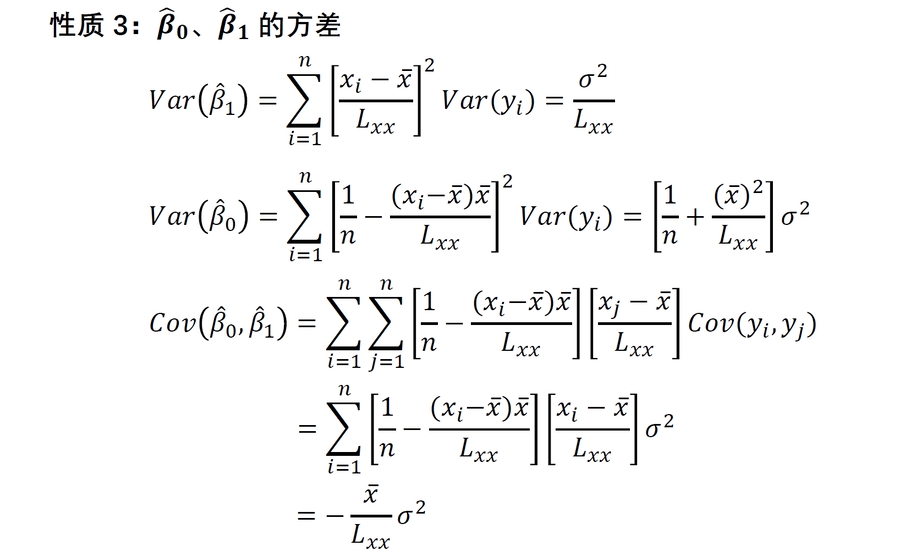

β0,β1是y1,y2,...,yn的线性组合:

β^1=i=1∑nLxx(xi−xˉ)yiβ^0=i=1∑n[n1−Lxx(xi−xˉ)xˉ]yi 给定xi,拟合值y^i可以表示为y1,y2,...,yn的线性组合

y^i=β^0+β^1xi=j=1∑n[n1+Lxx(xi−xˉ)(xj−xˉ)]yj≐j=1∑nhijyj 残差ei可以表示为y1,y2,...,yn的线性组合

ei=yi−y^i=yi−j=1∑nhijyj 注意,hij=hji是只和x有关的量。

截距项β0的估计量

β^0∼N(β0,[n1+Lxxxˉ2]σ2) 斜率项β1的估计量

β^1∼N(β1,Lxxσ2) 估计量的协方差

Cov(β^0,β^1)=−Lxxxˉσ2

回归系数的显著性检验(t检验)

构造t统计量,其中σ^2为σ2的无偏统计量

t=σ^2/Lxxβ^1−0 回归方程的显著性检验(F检验)

构造F统计量服从卡方分布,右侧检验,越大越拒绝

F=SSE/n−2SSR/1其中SST=i=1∑n(yi−yˉ)2、SSR=i=1∑n(y^i−yˉ)2,SSE=i=1∑n(y^i−yi)2 残差ei可以表示为y1,y2,...,yn的线性组合

ei=yi−y^i=yi−j=1∑nhijyj其中hij=n1+Lxx(xi−xˉ)(xj−xˉ) 残差ei可以看做随机变量ε的非独立样本

当i=j时Cov(ei,ej)=(1−hii)σ2当i=j时Cov(ei,ej)=−hijσ2 E(∑ei2)=∑E(ei2)=∑Var(ei)=∑(1−hii)σ2=(n−∑hii)σ2=(n−2)σ2 度量了自变量空间中的第i个数据偏离数据中心的程度

i=1∑nhii=2,即tr(H)=2j=1∑nhij2=hiik=1∑nhikhkj=hij 以上性质在多元中,联系帽子矩阵H可方便理解

y^0=j=1∑nh0jyj∼N(β0+β1x0,j=0∑nh0j2×σ2)=N(β0+β1x0,h00×σ2)y0−y^0∼N(0,(1+h00)σ2)t=(1+h00)σ2y0−y^0∼t(n−2) 故y0置信水平为1−α的预测区间为y^0±tα/2×(1+h00)σ,h00称为新值x0的杠杆值

h00=n1+Lxx(x0−xˉ)2 样本量越大,Lxx越大,x0越靠近xˉ,则h00越小,区间长度越短,预测精度越高

因为E(y^0)为常量,所以方差为0

y0−E(y^0)∼N(0,h00×σ2)t=h00×σ2y0−y^0∼t(n−2) Y=Xβ+εE(ε)=0Var(ε)=σ2In 误差随机项

εGauss-Markov条件

E(ε)=0Var(ε)=σ2In 随机误差项满足正态分布假设,矩阵表示形式为ε∼N(0,σ2In),此时Y∼N(Xβ,σ2In)

目标函数Q(β^)最小

Q(β^)=(Y−Xβ)T(Y−Xβ)最小得到β^=(XTX)−1XTY 引入帽子矩阵(投影矩阵)H=X(XTX)−1XT的概念,其各元素为hij,即为一元回归中的杠杆值

Y^=Xβ^=X(XTX)−1XTY≐HYe=Y−Y^=(I−H)Y 其中H是只和X相关的量

tr(H)=∑j=1nhjj=p+1

rk(H)=tr(H)=p+1

rk(I−H)=n−p−1

实对称幂等矩阵的特征根非0即1

极大似然估计量是有偏的估计

σ^2=n1(Y−Xβ)T(Y−Xβ)=n1eTe 无偏估计为

σ^2=n−p−11eTe=n−p−11YT(In−H)Y 因为

E(eTe)=E(i=1∑nei2)=i=1∑nE(ei2)=i=1∑nVar(ei2)=(n−p−1)σ2 Var(β^)=Cov(β^,β^)=σ2(XTX)−1 通常(XTX)−1为非对角矩阵,即β^各分量间具有相关性

与一元模型一致

当i=j时Cov(ei,ej)=(1−hii)σ2当i=j时Cov(ei,ej)=−hiiσ2 Cov(e,Y^)=Cov((In−H)Y,HY)=0

Cov(e,y^o)=Cov((In−H)Y,xo(XTX)−1XTY)=0

Cov(e,β^)=Cov((In−H)Y,(XTX)−1XTY)=0

观测Y

Y∼N(Xβ,σ2In) 参数估计值

β^∼N(β,σ2(XTX)−1) 预测值Y^

Y^=HY∼N(Xβ,σ2H) 预测单值y^0

y^0=x0T(XTX)XTY∼N(x0Tβ,σ2x0T(XTX)−1x0) 残差向量e

e=(In−H)Y∼N(0,σ2(In−H)) SSE/σ2

σ2(n−p−1)σ^2=σ2SSE=σ2YT(In−H)Y∼χ2(n−p−1) σ^2与β^独立

右侧检验,越大越拒绝,认为模型有效

F=SSE/(n−p−1)SSR/p SSR

YT(H−n11n1nT)Y 其中Rank(H−n11n1nT)=p+1−1=p

SSE

YT(In−H)Y 其中Rank(In−H)=n−p−1

SST

YT(In−n11n1nT)Y

其中Rank(In−n11n1nT)=n−1

参数估计值β^∼N(β,σ2(XTX)−1)

β^j∼N(0,σ2cjj) 其中cjj表示(XTX)−1第j+1个对角线上的元素

tj=cjjσβ^j∼t(n−p−1) R2表示因变量的变异中,自变量可以解释的比例

R2=SSTSSR Ra2=1−n−p−1n−1(1−R2) 构造t统计量

t=1+x0T(XTX)−1x0Tσ^y0−y^0∼t(n−p−1) 故y0置信水平为1−α的预测区间为y^0±tα/2(n−p−1)×1+x0T(XTX)−1x0Tσ^

t=x0T(XTX)−1x0Tσ^y^0−E(y0)∼t(n−p−1) 故y0置信水平为1−α的预测区间为y^0±tα/2(n−p−1)×x0T(XTX)−1x0Tσ^

X中心化后,斜率的估计量不变,截距项的估计值变为yˉ

X、Y中心化,斜率的估计量不变,截距项的估计值变为0

e=Y−Y^=Y−HY=(I−H)Y 将残差进行标准化,$Var(e_i) = (1-h_{ii})\sigma^2$

ri=var(ei)^ei=σ^1−hiiei 即使$\varepsilon \sim N(0,1)$,$r_i$的分布依旧比较复杂,且诸$r_i$间彼此不独立

E(ri)=0Var(ei)=1ρ(ri.rj)=1−hii1−hjj−hij 但是在实际应用中,还是近似将$r_i$认为为服从标准正态分布

以某种残差为纵坐标,某一合适的量为横坐标的散点图

<\div>

<\div>